Nos últimos meses, o Facebook enfrentou reações adversas de seus próprios cofundadores e ex-funcionários. Sean Parker disse que ele, ao lado de Mark Zuckerberg, criou conscientemente a rede social para explorar um “vulnerabilidade na psicologia humana”E expressou preocupação sobre o que isso está fazendo com o cérebro de nossos filhos. Embora o inventor do botão Curtir, Justin Rosenstein, tenha admitido arrependimento por ajudar a tornar as pessoas obcecadas pelas mídias sociais.

Numa tentativa de desfazer alguns destes danos à reputação e ajudar genuinamente os seus utilizadores, o Facebook anunciou planos para expandir as suas ferramentas de prevenção do suicídio.

LEIA A SEGUIR: Sentindo-se deprimido? Como obter ajuda e suporte on-line

Não é uma iniciativa totalmente nova – as ferramentas de prevenção do suicídio fazem parte do Facebook há mais de uma década – mas a empresa está a intensificar o seu jogo com o uso da IA. Com base num ensaio recente nos Estados Unidos, o Facebook está a utilizar a aprendizagem de padrões em publicações previamente sinalizadas como suicídio, na esperança de que o site possa intervir mesmo sem uma denúncia manual. É claramente uma linha difícil de seguir no que diz respeito à privacidade versus segurança e, portanto, o Facebook tem algumas opções para isso.

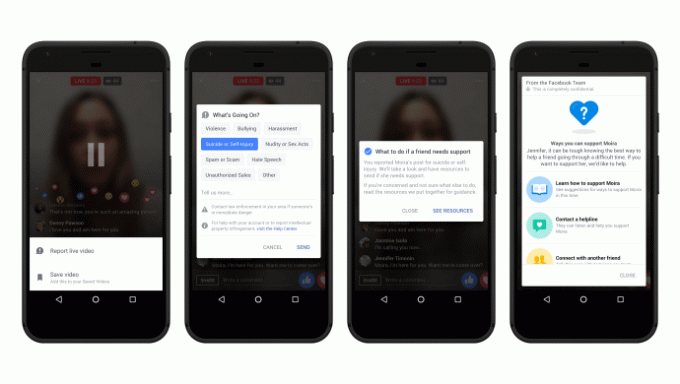

A primeira é no formato de uma cutucada para os amigos dos usuários. Se a IA detectar um padrão de texto que corresponda a relatos de suicídio anteriores, é provável que a opção de denunciar a postagem por “suicídio ou automutilação” apareça com mais destaque ao lado dele, facilitando a intervenção dos amigos.

Veja relacionado

Também está sendo testado um recurso que sinaliza automaticamente essas postagens para revisão pela equipe de operações comunitárias da empresa. Se as suspeitas da IA forem confirmadas pelo olho humano, o site fornecerá recursos para a pessoa mesmo sem a intervenção de seus amigos. Em uma postagem dele página pessoal do Facebook, Zuckerberg explicou: “A partir de hoje, estamos atualizando nossas ferramentas de IA para identificar quando alguém está expressando pensamentos sobre suicídio no Facebook, para que possamos ajudá-lo a obter o suporte de que precisam rapidamente. Só no último mês, essas ferramentas de IA nos ajudaram a nos conectar rapidamente com os socorristas mais de 100 vezes.

“Com todo o medo sobre como a IA pode ser prejudicial no futuro, é bom lembrar-nos de como a IA está realmente ajudando a salvar a vida das pessoas hoje.”

O suicídio é uma das principais causas de morte entre jovens e o Facebook disse que está trabalhando em estreita colaboração com Salvar.org, Linha de Vida Nacional para Prevenção do Suicídio ‘1-800-273-TALK (8255)’, Vanguarda Suicide Prevent e com socorristas para melhorar continuamente o software.

Veja relacionado

Como as pessoas em risco reagirão a uma intervenção de IA é uma questão em aberto, e que poderia simplesmente afastar os sinais de alerta comportamental dos olhares indiscretos do Facebook. O equilíbrio entre privacidade e urgência em agir é claramente uma fonte de debate interno. Gerente de produto do Facebook, Vanessa Callison-Burch disse ao BBC a empresa tem de equilibrar respostas eficazes e ser demasiado invasiva – informando diretamente amigos e familiares, por exemplo. “Somos sensíveis à privacidade e acho que nem sempre conhecemos a dinâmica pessoal entre as pessoas e seus amigos dessa forma, então estamos tentando fazer algo que ofereça apoio e opções”, ela explicou.

Embora a IA ainda não tenha sido integrada aos serviços em tempo real do Facebook, a empresa também tentou tornar o Facebook Live e o Messenger mais úteis para pessoas em crise. As ferramentas existentes para entrar em contato ou denunciar foram incorporadas ao serviço de transmissão do Facebook Live, e o Messenger agora oferece aos usuários a opção de conecte-se com serviços de suporte em tempo real, incluindo Crisis Text Line, National Eating Disorders Association e National Suicide Prevention Linha de vida.

Em um postagem no blog ao anunciar o recente julgamento, a empresa explicou as suas motivações: principalmente que tem o poder de fazer a diferença. “Os especialistas dizem que uma das melhores maneiras de prevenir o suicídio é fazer com que as pessoas em perigo ouçam as pessoas que se preocupam com elas”, diz a postagem do blog. “O Facebook está numa posição única – através de amizades no site – para ajudar a conectar uma pessoa em perigo com pessoas que podem apoiá-la.”

Isso pode muito bem ser verdade, mas seria tolice ignorar o clima mais amplo em que estas atualizações chegaram. Este ano já assistiu a um número de relatadotransmissões de suicídio no Facebook Live – e embora seja possível que essas ferramentas adicionais não tivessem feito nada para evitá-los, não é uma boa ideia que a rede social seja vista ignorando o problema.

LEIA A SEGUIR: Aumento nas pesquisas sobre suicídio ligadas a 13 razões pelas quais

Não é a primeira vez que o Facebook usa inteligência artificial para tentar torná-lo um lugar mais acolhedor: de volta em abril Em 2016, o site anunciou que estava usando IA para descrever o conteúdo das imagens para seus usuários com deficiência visual. Com três laboratórios dedicados à pesquisa de IA e quase dois bilhões de usuários de inteligência artificial para aprender, é improvável que esta seja a última vez que o Facebook tenta resolver um problema com a máquina aprendizado.

Também não é a primeira vez que a IA é usada desta forma na tentativa de identificar pessoas em risco. Usando um decodificador neural previamente treinado para identificar emoções, bem como pensamentos complexos, pesquisadores da Universidade de Pittsburgh e Carnegie Mellon University desenvolveram recentemente um algoritmo que pode detectar sinais de ideação suicida e comportamento.

LEIA A SEGUIR: Suicídio, depressão e a indústria tecnológica

Os pesquisadores aplicaram seus algoritmo de aprendizado de máquina às varreduras cerebrais e o software identificou corretamente se uma pessoa estava em um grupo de risco com 91% de precisão, usando mudanças em seus padrões de ativação cerebral.

Um teste de acompanhamento viu a IA sendo treinada especificamente nas varreduras cerebrais das pessoas do grupo vinculado com pensamentos suicidas para ver se o software poderia identificar aqueles que já haviam tentado suicídio. Estava correto em 94% dos casos.

Se você ou um ente querido foi afetado pelas questões levantadas nesta história, você pode obter apoio e aconselhamento em em nosso guia de ajuda e suporte on-line. Você também pode chegar ao samaritanos gratuitamente 24 horas por dia no 1116 123 ou no grupo de apoio Campanha Contra Viver Miseravelmente (CALM) especificamente para homens jovens pelo telefone 0800 585858.